Четыре года назад мы запустили Алису. С самого начала она обладала собственным, узнаваемым голосом. Хотя проблемы тоже были: интонации хромали, эмоции скакали от слова к слову, а омонимы и вовсе ставили синтез в тупик. Алиса звучала пусть и не как робот, но ещё и не как человек.

Исследования показывают, что желание общаться с голосовым помощником напрямую зависит от того, насколько точно он имитирует речь людей. Поэтому мы постоянно работаем над «очеловечениванием» голоса Алисы. С тех пор сменилось несколько поколений нашего голосового синтеза. Мы научились расставлять интонации, отличать «замОк» от «зАмка» и многое другое.

Сейчас мы переходим на следующий уровень: учим Алису управлять эмоциями и стилем своей речи, распознавать шёпот и отвечать на него шёпотом. Казалось бы, что в этом сложного и почему всё это было невозможно ещё несколько лет назад? Вот об этом я и расскажу сегодня сообществу Хабра.

Ранний параметрический синтез: эпоха до Алисы

Мы начали заниматься голосовыми технологиями в 2012 году. Через год родился SpeechKit. Ещё через год мы научились синтезировать голос — возможно, вы помните YaC 2014 и экспериментальный проект Яндекс.Диктовка. С тех пор прогресс не останавливается.

Исторически речевой синтез бывает двух видов: конкатенативный и параметрический. В случае с первым, есть база кусочков звука, размеченных элементами речи — словами или фонемами. Мы собираем предложение из кусочков, конкатенируя (то есть склеивая) звуковые сегменты. Такой метод требует большой базы звука, он очень дорогой и негибкий, зато до пришествия нейросетей давал самое высокое качество.

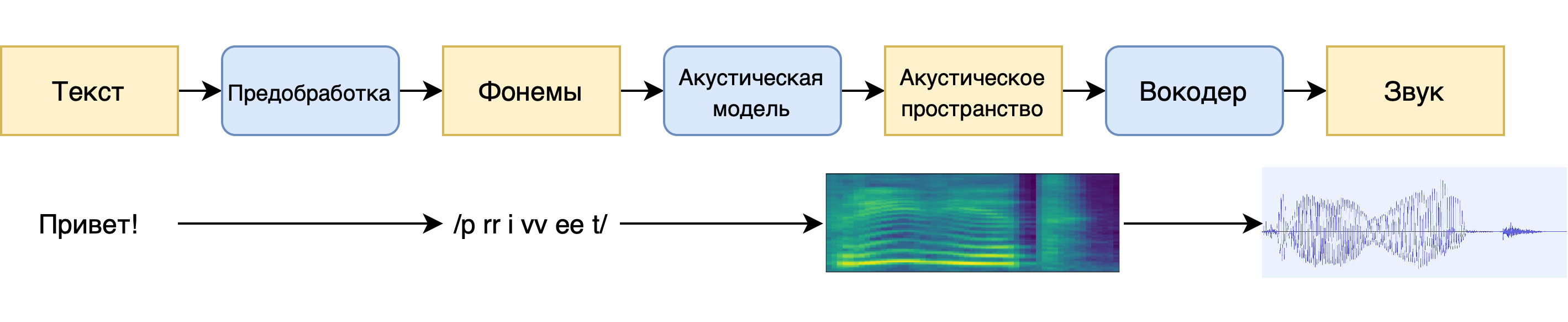

При параметрическом синтезе базы звука нет — мы рисуем его с нуля. Из-за большого прыжка в размерности end2end работает плохо даже сейчас. Лучше разделить это преобразование на два шага: сначала нарисовать звук в особом параметрическом (отсюда название метода) пространстве, а затем преобразовать параметрическое представление звука в wav-файл.

В 2014 году нейросетевые методы речевого синтеза только зарождались. Тогда качеством правил конкатенативный синтез, но нам в эру SpeechKit было необходимо легковесное решение (для Навигатора), поэтому остановились на простом и дешёвом параметрическом синтезе. Он состоял из двух блоков:

- Первый — акустическая модель. Она получает лингвистические данные (разбитые на фонемы слова и дополнительную разметку) и переводит их в промежуточное состояние, которое описывает основные свойства речи — скорость и темп произнесения слов, интонационные признаки и артикуляцию — и спектральные характеристики звука. К примеру, в начале, до появления Алисы, в качестве модели мы обучали рекуррентную нейросеть (RNN) с предсказанием длительности. Она достаточно хорошо подходит для задач, где нужно просто последовательно проговаривать фонемы и не надо рисовать глобальную интонацию.

- Затем данные передаются на второй блок — вокодер — который и генерирует звук (то есть создаёт условный wav) по его параметрическому представлению. Вокодер определяет низкоуровневые свойства звука: sampling rate, громкость, фазу в сигнале. Наш вокодер в первой системе был детерминированным DSP-алгоритмом (не обучался на данных) — подобно декодеру mp3, он «разжимал» параметрическое представление звука до полноценного wav. Естественно, такое восстановление сопровождалось потерями — искусственный голос не всегда был похож на оригинал, могли появляться неприятные артефакты вроде хрипов для очень высоких или низких голосов.

Схема параметрического синтеза

Это стандартная архитектура для любой ранней параметрики со своими достоинствами и недостатками. Главный плюс — для обучения модели нужно мало данных (нам хватило 5-10 часов записей человеческой речи). Можно синтезировать любой произвольный текст, который даже будет плавно звучать. К сожалению, слишком плавно: недостатком раннего параметрического синтеза было то, что полученный голос звучал неестественно. Он был слишком гладким, лишённым интонаций и эмоций, звенел металлом. Люди так не говорят.

Вот как звучал голос при раннем параметрическом синтезе:

Причина неестественности синтезированного голоса кроется в самой архитектуре. У акустической модели мало информации о тексте в целом. Даже рекуррентная нейросеть, которая, казалось бы, умеет запоминать предыдущие состояния, очень быстро забывает их и фактически не учитывает полный текст. При этом человек обычно произносит речь, понимая, что только что прозвучало и что будет дальше по тексту.

Кроме того, человеческая речь мультимодальна — есть несколько способов произнести текст, каждый из которых описывается сигналом и звучит более-менее нормально. Но среднее между этими способами звучит неестественно. Проблема стандартных регрессионных методов глубокого обучения в том, что они ищут одну моду — «хорошее среднее» — и попадают в такие «провалы неестественности». В результате оказывается, что лучше случайно выбрать один из двух способов, чем попасть в среднее между ними.

Впрочем, даже если акустическая модель и смогла бы разобраться в контексте и выдать обогащённое информацией промежуточное состояние, то с ним уже не мог справиться примитивный вокодер. Поэтому мы не остановились и стали искать более совершенные решения.

Конкатенативный синтез: рождение Алисы

В 2016 году мы решили создать Алису — сразу было понятно, что это более амбициозная задача, чем всё, чем занимались раньше. Дело в том, что в отличие от простых TTS-инструментов, голосовой помощник должен звучать человечно, иначе люди просто не станут с ним (или с ней) общаться. Предыдущая архитектура совершенно не подходила. К счастью, был и другой подход. Точнее, даже два.

Тогда как раз набирал обороты нейропараметрический подход, в котором задачу вокодера выполняла сложная нейросетевая модель. Например, появился проект WaveNet на базе свёрточной нейросети, которая могла обходиться и без отдельной акустической модели. На вход можно было загрузить простые лингвистические данные, а на выходе получить приличную речь.

Первым импульсом было пойти именно таким путём, но нейросети были совсем сырые и медленные, поэтому мы не стали их рассматривать как основное решение, а исследовали эту задачу в фоновом режиме. На генерацию секунды речи уходило до пяти минут реального времени. Это очень долго: чтобы использовать синтез в реальном времени, нужно генерировать секунду звука быстрее, чем за секунду.

Что же делать? Если нельзя синтезировать живую речь с нуля, нужно взять крошечные фрагменты речи человека и собрать из них любую произвольную фразу. Напомню, что в этом суть конкатенативного синтеза, который обычно ассоциируется с методом unit selection. Пять лет назад он уже давал наилучшее качество (при достаточном количестве данных) в задачах, где была нужна качественная речь в реальном времени. И здесь мы смогли переиспользовать нейросети нашей старой параметрики. Работало это следующим образом:

- На первом шаге мы использовали нейросетевую параметрику, чтобы синтезировать речь с нуля — подобному тому, как делали раньше. Напомню, что по качеству звучания результат нас не устраивал, но мог использоваться как референс по содержанию.

- На втором шаге другая нейросеть подбирала из базы фрагментов записанной речи такие, из которых можно было собрать фразу, достаточно близкую к сгенерированной параметрикой. Вариантов комбинаций фрагментов много, поэтому модель смотрела на два ключевых показателя. Первый — target-cost, точность соответствия найденного фрагмента гипотезе, то есть сгенерированному фрагменту. Второй показатель — join-cost, насколько два найденных соседних фрагмента соответствуют друг другу. По сути, нужно было выбрать вариант, для которого сумма target-cost и join-cost минимальна. Эти параметры можно считать разными способами — для join-cost мы использовали нейросети на базе Deep Similarity Network, а для target-cost считали расстояние до сгенерированной параметрикой гипотезы. Сумму этих параметров, как и принято в unit selection, оптимизировали динамическим программированием.

Кстати, подобный подход использовался и при создании Siri 2.0, согласно опубликованной в 2017 году статье разработчиков Apple, которую мы нашли после того, как запустили прототип Алисы.

Схема конкатенативного синтеза

У такого подхода тоже есть плюсы и минусы. Среди достоинств — более естественное звучание голоса, ведь исходный материал не синтезирован, а записан вживую. Правда, есть и обратная сторона: чем меньше данных, тем более грубо будут звучать места склейки фрагментов. Для шаблонных фраз всё более-менее хорошо, но шаг влево или вправо — и вы замечаете склейку. Поэтому нужно очень много исходного материала, а это требует многих часов записи голоса диктора. К примеру, в первые несколько лет работы над Алисой нам пришлось записать несколько десятков часов. Это несколько месяцев непрерывной работы с актрисой Татьяной Шитовой в студии.

При этом нужно не просто «прочитать текст по листочку». Чем более нейтрально будет звучать голос, тем лучше. Обычно от актёров ждут эмоциональности, проявления темперамента в своей речи. У нас ровно обратная задача, потому что нужны универсальные «кубики» для создания произвольных фраз.

Вот характерный пример работы синтеза:

В этом главный недостаток метода unit selection: несмотря на все усилия, фрагменты речи не будут идеально соответствовать друг другу по эмоциям и стилю. Из-за этого сгенерированная речь Алисы постоянно «переключалась» между ними. На коротких фразах это не всегда заметно, но если хотите услышать произвольный ответ длиной хотя бы в пару предложений (например, быстрый ответ из поиска), то недостатки подхода становятся очевидны.

В общем, unit selection перестал нас устраивать и нужно было развиваться дальше.

Иногда они возвращаются: опять параметрический синтез

В результате мы вернулись к архитектуре из двух последовательных блоков: акустическая модель и вокодер. Правда, на более низком уровне обновилось примерно всё.

1. Акустическая модель

В отличие от старой параметрики, новую модель мы построили на основе seq2seq-подхода с механизмом внимания.

Помните проблему с потерей контекста в нашей ранней параметрике? Если нет нормального контекста, то нет и нормальной интонации в речи. Решение пришло из машинного перевода.

Дело в том, что в машинном переводе как раз возникает проблема глобального контекста — смысл слов в разных языках может задаваться разным порядком или вообще разными структурами, поэтому порой для корректного перевода предложения нужно увидеть его целиком. Для решения этой задачи исследователи предложили механизм внимания — идея в том, чтобы рассмотреть всё предложение разом, но сфокусироваться (через softmax-слой) на небольшом числе «важных» токенов.

При генерации каждого нового выходного токена нейросеть смотрит на обработанные токены (фонемы для речевого синтеза или символы языка для перевода) входа и «решает», насколько каждый из них важен на этом шаге. Оценив важность, сеть учитывает её при агрегировании результатов и получает информацию для генерации очередного токена выхода.

Таким образом нейросеть может заглянуть в любой элемент входа на любом шаге и при этом не перегружается информацией, поскольку фокусируется на небольшом количестве входных токенов. Для синтеза важна подобная глобальность, так как интонация сама по себе глобальна и нужно «видеть» всё предложение, чтобы правильно его проинтонировать.

На тот момент для синтеза была хорошая seq2seq-архитектура Tacotron 2 — она и легла в основу нашей акустической модели.

2. Мел-спектрограмма

Параметрическое пространство можно сжать разными способами. Более сжатые представления лучше работают с примитивными акустическими моделями и вокодерами — там меньше возможностей для ошибок. Более полные представления позволяют лучше восстановить wav, но их генерация — сложная задача для акустической модели. Кроме того, восстановление из таких представлений у детерминированных вокодеров не очень качественное из-за их нестабильности. С появлением нейросетевых вокодеров сложность промежуточного пространства стала расти и сейчас в индустрии одним из стандартов стала мел-спектрограмма.

Она отличается от обычного распределения частоты звука по времени тем, что частоты переводятся в особую мел-частоту звука. Другими словами, мел-спектрограмма — это спектрограмма, в которой частота звука выражена в мелах, а не герцах. Мелы пришли из музыкальной акустики, а их название — это просто сокращение слова «мелодия».

Строение улитки уха (из Википедии)

Эта шкала не линейная и основана на том, что человеческое ухо по-разному воспринимает звук различной частоты. Вспомните строение улитки в ухе: это просто канал, закрученный по спирали. Высокочастотный звук не может «повернуть» по спирали, поэтому воспринимается достаточно короткой частью слуховых рецепторов. Низкочастотный же звук проходит вглубь. Поэтому люди хорошо различают низкочастотные звуки, но высокочастотные сливаются.

Мел-спектрограмма как раз позволяет представить звук, акцентируясь на той части спектра, которая значимо различается слухом. Это полезно, потому что мы генерируем звук именно для человека, а не для машины.

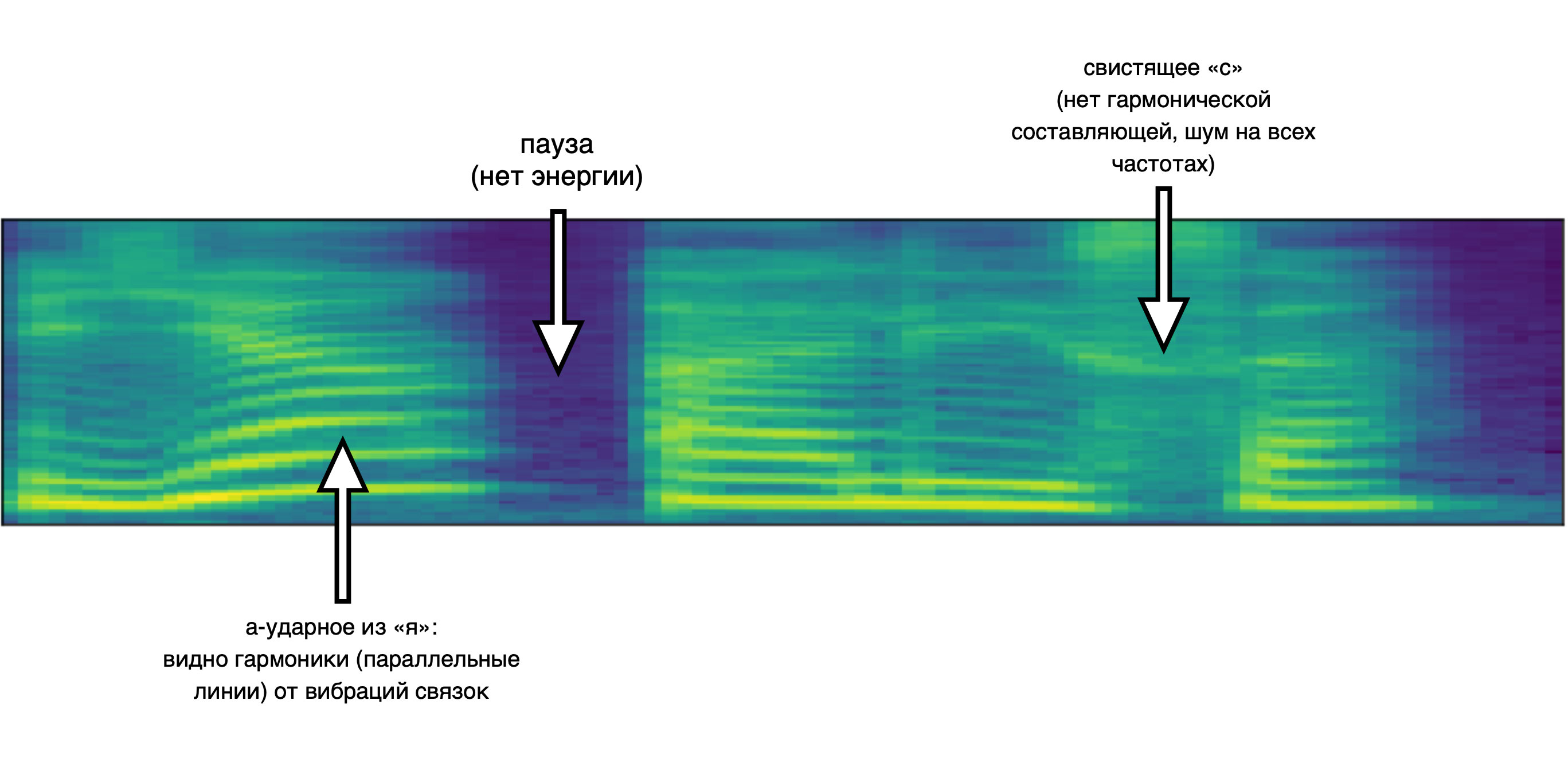

Вот как выглядит мел-спектрограмма синтеза текста «Я — Алиса»:

У мел-спектрограммы по одному измерению [X на рисунке выше] — время, по другому [Y] — частота, а значение [яркость на рисунке] — мощность сигнала на заданной частоте в определенный момент времени. Проще говоря, эта штуковина показывает, какое распределение по мощностям было у различных частот звука в конкретный момент. Мел-спектрограмма непрерывна, то есть с ней можно работать как с изображением.

А так звучит результат синтеза:

3. Новый вокодер

Вероятно, вы уже догадались, что мы перешли к использованию нового нейросетевого вокодера. Именно он в реальном времени превращает мел-спектрограмму в голос. Наиболее близкий аналог нашего первого решения на основе нейросетей, которое вышло в 2018 году — модель WaveGlow.

Архитектура WaveGlow основана на генеративных потоках — довольно изящном методе создания генеративных сетей, впервые предложенном в статье про генерацию лиц. Сеть обучается конвертировать случайный шум и мел-спектрограмму на входе в осмысленный wav-сэмпл. За счёт случайного шума на входе обеспечивается выбор случайной wav-ки — одной из множества соответствующих мел-спектрограмме. Как я объяснил выше, в домене речи такой случайный выбор будет лучше детерминированного среднего по всем возможным wav-кам.

В отличие от WaveNet, WaveGlow не авторегрессионен, то есть не требует для генерации нового wav-сэмпла знания предыдущих. Его параллельная свёрточная архитектура хорошо ложится на вычислительную модель видеокарты, позволяя за одну секунду работы генерировать несколько сотен секунд звука.

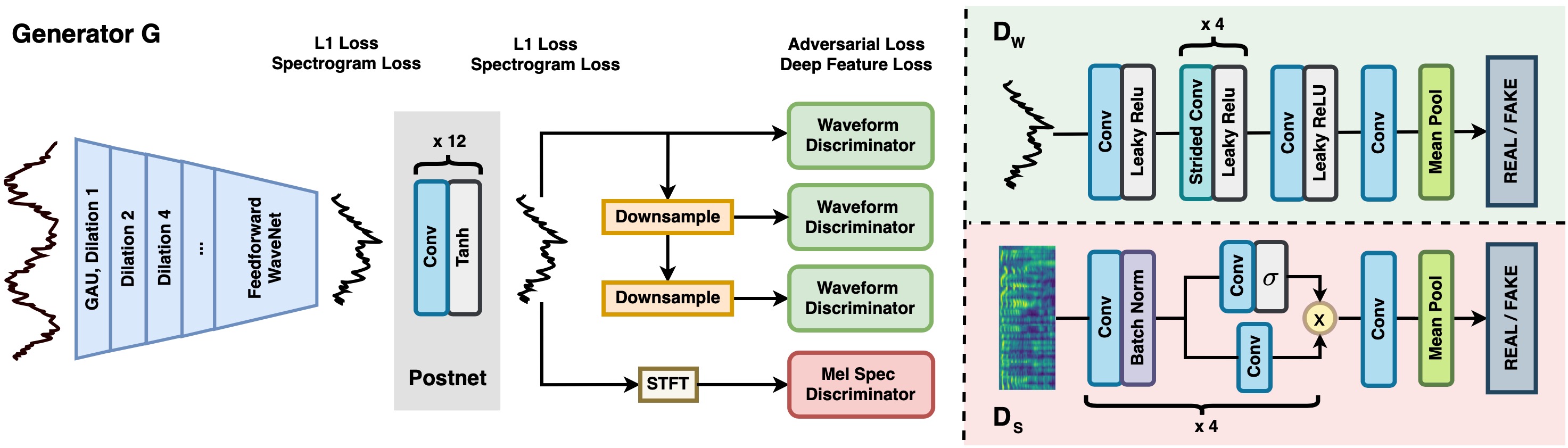

Затем вышла модель HiFi-GAN, которая сильно выигрывала по качеству у других решений. HiFi-GAN — доработка генеративно-состязательной сети MelGAN, создающей wav-сэмплы на основе мел-спектрограммы.

Главное отличие, за счёт которого HiFi-GAN обеспечивает гораздо лучшее качество, заключается в наборе подсетей-дискриминаторов. Они валидируют натуральность звука, смотря на сэмплы с различными периодами и на различном масштабе. Как и WaveGlow, HiFi-GAN не имеет авторегрессионной зависимости и хорошо параллелится, при этом новая сеть намного легковеснее, что позволило при реализации ещё больше повысить скорость синтеза. Кроме того, оказалось, что HiFi-GAN лучше работает на экспрессивной речи, что в дальнейшем позволило запустить эмоциональный синтез — об этом подробно расскажу чуть позже. Летом 2021 года мы полностью перешли на HiFi-GAN.

Схема HiFi-GAN из статьи авторов модели

Комбинация этих трёх компонентов позволила вернуться к параметрическому синтезу голоса, который звучал плавно и качественно, требовал меньше данных и давал больше возможностей в кастомизации и изменении стиля голоса.

Параллельно мы работали над улучшением отдельных элементов синтеза:

- Летом 2019 года выкатили разрешатор омографов (homograph resolver) — он научил Алису правильно ставить ударения в парах «зАмок» и «замОк», «белкИ» и «бЕлки» и так далее. Здесь мы нашли остроумное решение. В русском языке эти слова пишутся одинаково, но в английском написание отличается, например, castle и lock, proteins и squirrels. Поэтому мы воспользовались моделью машинного перевода: взяли энкодер переводческой нейросети ru->en и извлекли эмбеддинг русского текста. Из этого представления легко выделить информацию о том, как произносить омограф, ведь перевод должен различать формы для корректного подбора английского варианта. Буквально на 20 примерах можно выучить классификатор для нового омографа, чтобы по эмбеддингу перевода понимать, какую форму нужно произнести.

- Летом 2020 года допилили паузер для расстановки пауз внутри предложения. Язык — хитрая штука. Не все знаки препинания в речи выражаются паузами Например, после вводного слова «конечно» на письме мы ставим запятую, но в речи обычно не делаем паузу. А там, где знаков препинания нет, мы часто делаем паузы. Если эту информацию не передавать в акустическую модель, то она пытается её выводить и не всегда успешно. Первая модель Алисы из-за этого могла начать вздыхать в случайных местах длинного предложения. Задача паузера — предсказать класс паузы (отсутствует/короткая/средняя/длинная) после каждого слова. Для этого мы взяли датасет, разметили его детектором активности голоса, сгруппировали паузы по длительности, ввели класс длины паузы, на каждое слово навесили тэг и на этом корпусе обучили ещё одну голову внимания из тех же нейросетевых эмбеддингов, что использовались для детекции омографов.

- Осенью 2020 года мы перевели на трансформеры нормализацию — в синтезе она нужна, чтобы решать сложные случаи, когда символы читаются не «буквально», а по неким правилам. Например, «101» нужно читать не как «один-ноль-один», а как «сто один», а в адресе yandex.ru нужно произносить точку — «яндекс точка ру». Обычно нормализацию делают через комбинацию взвешенных трансдьюсеров (FST) — правила напоминают последовательность замен по регулярным выражениям, где выбирается замена, имеющая наибольший вес. Мы долго писали правила вручную, но это отнимало много сил, было очень сложно и не масштабируемо. Тогда решили перейти на трансформерную сеть, «задистиллировав» знания наших FST в нейронку. Теперь новые «правила раскрытия» можно добавлять через доливание синтетики и данных, размеченных пользователями Толоки, а сеть показывает лучшее качество, чем FST, потому что учитывает глобальный контекст.

Итак, мы научили Алису говорить с правильными интонациями, но это не сделало ее человеком — ведь в нашей речи есть еще стиль и эмоции. Работа продолжалась.

С чувством, толком, расстановкой: стили голоса Алисы

Один и тот же текст можно произнести десятком разных способов, при этом сам исходный текст, как правило, никаких подсказок не содержит. Если отправить такой текст в акустическую модель без дополнительных меток и обучить её на достаточно богатом различными стилями и интонациями корпусе, то модель сойдёт с ума — либо переусреднит всё к металлическому «голосу робота», либо начнёт генерировать случайный стиль на каждое предложение. Это и произошло с Алисой: в начале она воспроизводила рандомные стили в разговоре. Казалось, что у неё менялось настроение в каждом предложении.

Вот пример записи с явными перебоями в стилях:

Чтобы решить проблему, мы добавили в акустическую модель стили: в процессе обучения нейросети специально ввели «утечку». Суть в том, что через очень lossy-пространство (всего 16 чисел на всё предложение) разрешаем сетке посмотреть на ответ — истинную мел-спектрограмму, которую ей и нужно предсказать на обучении. За счёт такой «шпаргалки» сеть не пытается выдумывать непредсказуемую по тексту компоненту, а для другой информации не хватит размерности шпаргалки.

На инференсе мы генерируем стилевую подсказку, похожую на те, что были в обучающем сете. Это можно делать, взяв готовый стиль из обучающего примера или обучив специальную подсеть генерировать стили по тексту.

Если эту подсеть обучить на особом подмножестве примеров, можно получить специальные стили для, скажем, мягкого или дружелюбного голоса. Или резкого и холодного. Или относительно нейтрального. Чтобы определиться со стилем по умолчанию, мы устроили турнир, где судьями выступали пользователи Толоки. Там не было разметки, мы просто нашли кластеры стилей и провели между ними соревнование. Победил кластер с очень мягкой и приятной интонацией.

Дальше началось самое интересное. Мы взяли образцы синтезированной «мягкой» речи Алисы и фрагменты речи актрисы Татьяны Шитовой, которые относились к более резкому стилю. Затем эти образцы с одним и тем же текстом протестировали вслепую на толокерах. Оказалось, что люди выбирают синтезированный вариант Алисы, несмотря на более плохое качество по сравнению с реальной речью человека. В принципе, этого можно было ожидать: уверен, многие предпочтут более ласковый разговор по телефону (то есть с потерей в качестве) живому, но холодному общению.

К примеру, так звучал резкий голос:

А так — мягкий:

Результаты турниров позволили нам выделить во всем обучающем датасете данные, которые относятся к стилю-победителю, и использовать для обучения только их. Благодаря этому Алиса по умолчанию стала говорить более мягким и дружелюбным голосом.

Этот пример показывает, что с точки зрения восприятия важно работать не только над качеством синтеза, но и над стилем речи. После этого оставалось только обогатить Алису новыми эмоциями.

Бодрая или спокойная: управляем эмоциями Алисы

Когда вы включаете утреннее шоу Алисы или запускаете автоматический перевод лекции на YouTube, то слышите разные голоса — бодрый в первом случае и более флегматичный в другом. Эту разницу сложно описать словами, но она интуитивно понятна — люди хорошо умеют распознавать эмоции и произносить один и тот же текст с разной эмоциональной окраской. Мы обучили этому навыку Алису с помощью той же разметки подсказок, которую применили для стилей.

У языка есть интересное свойство — просодия, или набор элементов, которые не выражаются словами. Это особенности произношения, интенсивность, придыхание и так далее. Один текст можно произнести со множеством смыслов. Как и в случае со стилями речи, можно, например, выделить кластеры «веселая Алиса», «злая Алиса» и так далее.

Поскольку стилевой механизм отделяет просодию («как говорим») от артикуляции («что говорим»), то новую эмоцию можно получить буквально из пары часов данных. По сути, нейросети нужно только выучить стиль, а информацию о том, как читать сочетания фонем, она возьмёт из остального корпуса.

Прямо сейчас доступны три эмоции. Например, часть пользователей утреннего шоу Алисы слышат бодрую эмоцию. Кроме того, её можно услышать, спросив Алису «Кем ты работаешь?» или «Какую музыку ты любишь?». Флегматичная эмоция пригодилась для перевода видео — оказалось, что голос по умолчанию слишком игривый для этой задачи. Наконец, радостная эмоция нужна для ответов Алисы на специфические запросы вроде «Давай дружить» и «Орёл или решка?». Ещё есть негативная эмоция, которую пока не знаем, как использовать — сложно представить ситуацию, когда людям понравится, что на них ругается робот.

Первый корпус эмоций мы записали ещё при WaveGlow, но результат нас не устроил и выкатывать его не стали. С переходом на HiFi-GAN стало понятно, что он хорошо работает с эмоциями, это позволило запустить полноценный эмоциональный синтез.

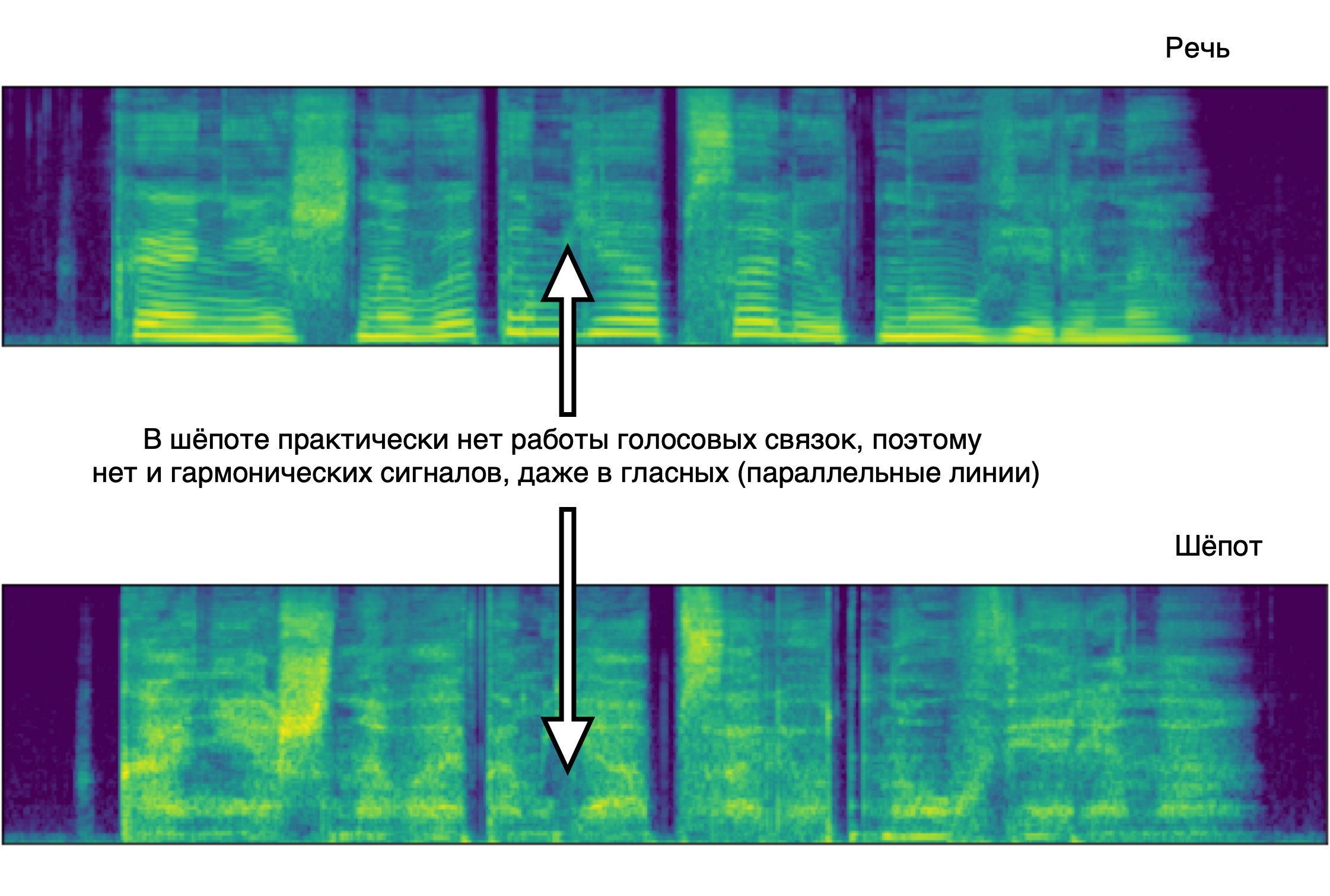

Наконец, мы решили внедрить шёпот. Когда люди обращаются к Алисе шёпотом, она должна и отвечать шёпотом — это делает её человечнее. При этом шёпот — не просто тихая речь, там слова произносятся без использования голосовых связок. Спектр звука получается совсем другим.

С одной стороны, это упрощает детекцию шёпота: по «картинке» мел-спектрограммы можно понять, где заканчивается обычная речь и начинается шепот. С другой стороны, это усложняет синтез шёпота: привычные механизмы обработки и подготовки речи перестают работать. Поэтому шёпотный синтез нельзя получить детерминированным преобразованием сигнала из речи.

Так выглядят мел-спектрограммы обычной речи и шёпота при произнесении одной и той же фразы:

Так звучит обычная речь:

А так — шёпот:

Сначала мы научили Алису понимать шёпот. Для этого обучили нейросеть различать спектры звука для обычного голоса и шёпота. Система смотрит на спектр звука и решает, когда говорят шёпотом, а когда — голосом.

В процессе обучения оказалось, что спектры шёпота и речи курильщиков похожи, так что пришлось научить нейросеть их различать. Для этого собрали больше пограничных данных с речью курильщиков и простуженных людей и донастроили нейросеть на них.

Чтобы научить Алису говорить шёпотом, мы записали несколько часов шёпота речи в исполнении Татьяны Шитовой. Сложности начались уже на предобработке данных: наш VAD (детектор тишины в речи) сломался на шёпотных гласных — трудно отличить сказанное шёпотом «а!» от обычного громкого вздоха. Починить его удалось, только совместив признаки энергии сигнала и данные от распознавания речи, при этом под шёпот конструкцию пришлось калибровать отдельно.

Затем записанные данные добавили в обучающий корпус акустической модели. Мы решили рассматривать шёпот как еще один «стиль» речи или, в терминах нашего синтеза, «эмоцию». Добавив данные в трейнсет, мы дали акустической модели на вход дополнительную информацию — шёпот или эмоцию она сейчас проигрывает. По этому входу модель научилась по команде пользователя переключаться между генерацией речи и шёпота.

Сгенерированный шёпот по качеству не отличался от обычной речи. По нашей метрике PSER (Pronunciation Sentence Error Rate — средняя доля ошибок произношения в предложении) он оказался даже лучше. Оказалось, что ряд ошибок интонации в шёпотной речи были значительно менее ярко выражены.

Этот голос будет полезен при общении с Алисой ночью, чтобы не мешать близким. Можно задавать вопросы тихим голосом и Алиса будет отвечать шёпотом. Кроме того, такой стиль ещё и звучит очень приятно — поклонники ASMR оценят.

Послушайте, как шепчет Алиса:

На этом мы не останавливаемся — в планах дальнейшее развитие голосового синтеза, добавление новых стилей и эмоций. Обязательно продолжим рассказывать о том, как Алиса учится говорить по-человечески.

Интерактивные фигурки из «Холодного сердца», игры с наборами LEGO Duplo и игрушками Kinder, угадывания персонажей и безумные истории, квесты на диване с друзьями и алкотестер. Собрали нескучные идеи для беседы с «Алисой» внутри вашей умной колонки.

- Полезности, история и квесты

- Для взрослых и вместе с детьми

- Для детей

- Интерактивные игрушки

Голосовой помощник «Алиса», который установлен внутри всех «Яндекс-станций» и в некоторых колонках от партнеров «Яндекса», многие используют для таймера, будильника и новостей о погоде. На самом деле «Алиса» умнеет с каждым днем. И немалую роль в этом играют специальные навыки, с которыми взаимодействие с колонкой становится еще интереснее.

Навыки — это такие как бы приложения, запускающиеся по голосовой или текстовой команде на всех устройствах с «Алисой». Например, вы можете сказать: «Алиса, запусти навык „Угадай персонажа“». Сразу запустится классная игра, где она будет угадывать с помощью вопросов реального или вымышленного персонажа, которого вы загадали.

Мы отобрали несколько интересных на наш взгляд навыков «Алисы», с которыми можно сгладить хмурый дождливый вечер дома. Все они собраны на специальной странице. Отдельно можно посмотреть на рейтинг самых популярных.

А если у вас дома нет своей «Алисы», то вы всегда можете найти ее в Каталоге Onlíner с бесплатной доставкой и возвратом 5% на карту «Onlíner Клевер».

Полезности, история и квесты

«Зарядка для глаз». «Алиса» помогает отдохнуть от компьютера с помощью упражнений для глаз и расслабляющей фоновой музыки.

Настройка гитары. Просто скажите: «Запусти навык „Настройка гитары“». Работает наподобие популярных гитарных тюнеров на смартфонах, только на слух и без визуализации. Если сравнивать с ними, то звучание струн у «Алисы» совпадает с их показаниями.

«Тест на алкоголь». На основании показателей тела, возраста и количества выпитого «Алиса» рассчитывает, сколько у вас в организме алкоголя и можно ли садиться за руль. Правда, ориентируется на российские законы о допустимом содержании алкоголя в крови при вождении. В любом случае навык стоит воспринимать как строго развлекательный. А за руль ни в коем случае нельзя садиться пьяным. Независимо от количества выпитого.

«День Победы». Исторический навык, созданный «Радио Маяк» о событиях последних дней войны с 24 февраля до 15 мая. Юрий Левитан зачитывает сводки Советского информационного бюро о событиях на фронтах войны. Полезно как для школьников, так и для любителей истории и всех, кто хочет вспомнить о Великой Отечественной.

«Новгородские хроники». Очень подробное погружение в средневековый город. В навыке объясняется устройство города, его ключевые объекты и звучит много исторических терминов. Сюжет строится вокруг защиты независимости Новгорода от Москвы, где игроку необходимо принимать соответствующие важные решения. Затягивающий квест получился, жаль, не очень долгий.

«Любознательный Сальвадор». Навык для разбирающихся в живописи и архитектуре. «Алиса» задает вопросы о художниках, их жизни и, конечно, об их произведениях. Есть соревновательный режим с другом через интернет. Навык в целом интересный и познавательный, но требует подготовки. Обратите внимание, что его функционал отличается при использовании на компьютере или в приложении и на колонке, где все через голос и без картинок.

Кто помнит олдскульные текстовые игры, тот полюбит навыки «Алисы», где с помощью голосовых команд необходимо проходить целые квесты и задействовать самый мощный графический процессор — ваше воображение. Например, вот очень классный навык «Пещера Времени». Нарративный квест с интересным сюжетом и хорошей вариативностью действий. В таком же духе можете попробовать «Тайну темного лабиринта 2» с многоголосой озвучкой. Один из самых популярных навыков-квестов — «Секретный Агент». У него 13 тысяч оценок в каталоге навыков «Алисы», много голосов озвучки и четыре очень увлекательные миссии, где вам нужно исследовать разные локации, изучать документы, допрашивать подозреваемых и говорить с врагами так, чтобы не себя не выдать. Каждое решение тоже имеет последствия.

«Да, милорд». Прикольный навык и тоже про важность принятия решений и их последствия. По поручению короля вы управляете некоторыми землями и решаете все вопросы и проблемы. Например, строите медную шахту и нанимаете работникам крестьян с земель, где находится добыча. Ваше богатство и влияние растут. Но как только вы говорите на допросе инквизиции, что Земля вращается вокруг Солнца, вас арестуют за веру в еретические учения Коперника и Бруно.

По ходу игры надо постоянно соблюдать баланс между богатством и влиянием. Иначе король казнит вас за растраты и глупость или из-за боязни потерять власть и зависти к богатству.

Для взрослых и вместе с детьми

«Угадай персонажа» — №1 в чарте навыков «Алисы». Работает по принципу знаменитой компьютерной игры «Акинатор». Вы загадываете реального или вымышленного персонажа, а «Алиса» наводящими вопросами пытается его отгадать. Кто не играл в «Акинатор», тот гарантированно испытает детский восторг от того, как «Алиса» медленно подходит к разгадке персонажа, которого вы не произносили даже вслух. Многие знают застольный аналог этой игры со стикерами на лбу.

Навык «Сова — угадай книгу» работает точно так же, как предыдущий, только просит загадать книгу и героя из нее. Процесс игры аналогичный, а удовольствия не меньше.

«Занимательные истории». Вы говорите «Алисе» слова, а она составляет из них безумные, астрологические и просто прикольные истории.

«Три шкатулки». «Алиса» проверит вашу внимательность и память. Она кладет монетку в одну из шкатулок и меняет их местами, озвучивая свои действия вслух. Надо определить, в какой шкатулке монетка. В реальности это не так просто, как может показаться, особенно на сложных уровнях.

«Лимонадный киоск». Попробуйте себя в роли производителя и продавца лимонада. Перед каждым вам необходимо учитывать погодные условия, стоимость производства стаканчика лимонада, затраты на маркетинг в виде количества рекламных листовок и, конечно, стоимость одного стаканчика лимонада. Игра как для взрослых, так и для детей. С колонкой прикольно в нее играть, только вам точно потребуется записывать свои показатели и сводить дебет с кредитом на бумаге.

«Самый умный». Одна из многочисленных викторин среди навыков «Алисы» и копия телевизионной игры «Слабое звено». Нехитрые вопросы, быстрые ответы и пополнение банка. В конце обязательно кто-то выбывает. На выбор несколько уровней сложности. На легком можно играть с детьми.

Для детей

В детской категории собрано много навыков для младших школьников и дошкольников. Часть из них направлена на развитие тех или иных навыков. А другая часть — игры и викторины.

LEGO Duplo. Вместе с «Алисой» вы можете с вашим ребенком построить увлекательный рассказ вокруг конструктора из серии LEGO Duplo. Например, в наборе «Животные мира» необходимо найти гостей, которых лев пригласил на свой день рождения. «Алиса» сперва попросит найти человечка, потом найти ему машину или самолет из набора и проехать большой круг. Затем надо собрать всех животных вместе, а «Алиса» будет загадывать загадки про них и по-настоящему помогать, если возникнут трудности. Очень крутой навык, открывающий с новой стороны взаимодействие с умной колонкой и конструктором LEGO. Вот все наборы из этой серии, с которыми поможет играть «Алиса».

Игра «Графический диктант». Классическое упражнение из начальной школы. Отступаете несколько клеточек сверху и слева и начинаете рисовать картинку. «Алиса» говорит, на сколько клеточек надо провести линию влево или вправо. На выбор предлагается 17 картинок, что не очень много, но зато увлекательно.

«Чистим зубки» и «Моем ручки». Музыкальные навыки, прививающие хорошие привычки детям. На деле их проверить не удалось, но у «Чистим зубки» аж 3 тыс. оценок.

«Звериная зарядка». Помимо стандартной разминки, иногда ребенку надо побыть слоном, собачкой или лягушкой, выполняя характерные для этих животных активности.

«Изучаем транспорт». Навык позволяет узнать о разных видах транспорта и его назначении. Но самое в нем прикольное — угадывать транспорт по звуку. На компьютере или смартфоне еще доступны задания с картинками.

«Игра „Магазин“». Интересная ролевая игра, где ребенок выступает продавцом игрушек. Покупатели описывают игрушку, которую хотят купить, а вам надо отгадать, т. е. как бы найти ее на полке или складе. Там много музыки и сопроводительных звуков. А в озвучке выступают разные голоса, включая несколько искусственных.

«Угадай звук». «Алиса» воспроизводит разные звуки, а ребенку необходимо определить, что это. Например, дождь, лошадь, пианино, гром, море и т. д.

«Совенок — угадай книгу». «Я это называю мош инлетекта». Навык работает точно так же, как «Угадай персонажа», только с озвучкой детским голосом и только про персонажей из детских книжек.

Умная колонка может помочь с математическими навыками. В каталоге «Алисы» их очень много. Вот, например, «Икс на игрек» — навык для повторения таблицы умножения, где «Алиса» после каждого успешного раунда раздает комплименты в виде званий «Умница», «Гордость учителя», «Прирожденный математик» и т. д. Несколько уровней сложности есть в другом навыке «Увлекательная математика».

Интерактивные игрушки

Новый формат взаимодействия с умной колонкой теперь еще включает мягких и красивых «Смешариков» и детализированные фигурки героев из «Холодного сердца». После активации игрушки «Алиса» предложит сыграть в игру с интересной историей. Например, у Кроша это поиск сокровищ в Африке. Жаль, что на каждую игрушку лишь одна история.

Вместе с Эльзой, Олафом и, конечно же, «Алисой» вам предстоит устроить день рождения для Анны. У каждой фигурки тоже своя история и своя интересная игра. Если вы приобрели игрушки серии «Холодное сердце» в комплекте со станцией «Мини» (в единой упаковке), то отдельная активация игрушек не требуется: все мини-игры игрушек будут доступны для аккаунта на «Яндексе», связанного с новой колонкой.

Судя по отзывам, как взрослые, так и дети любят общаться с «Алисой». Благодаря многим ее навыкам такое общение теперь может стать еще разнообразнее и увлекательнее — квесты, викторины, повторение таблицы умножения, игрушки LEGO и мягкие «Смешарики»…